Contents

Trong thế giới công nghệ hiện đại, trí tuệ nhân tạo (AI) đang trở thành một phần không thể thiếu trong cuộc sống hàng ngày của chúng ta. Tuy nhiên, một hiện tượng gọi là AI hallucination (ảo giác AI) có thể gây ra mối đe dọa an ninh mạng đối với doanh nghiệp và cá nhân. AI hallucination là khi AI tạo ra thông tin sai lệch, có thể dẫn đến những hậu quả nghiêm trọng nếu không được nhận biết và ngăn chặn kịp thời. Bài viết này sẽ giúp bạn hiểu rõ hơn về nguyên nhân của AI hallucination, cách thức mà tin tặc có thể lợi dụng chúng, và những biện pháp bảo vệ hiệu quả để giữ an toàn cho bản thân và tổ chức của bạn.

Nguyên Nhân Dẫn Đến AI Hallucination

AI hallucination xảy ra do nhiều nguyên nhân khác nhau, nhưng chủ yếu là do dữ liệu đào tạo của AI không hoàn chỉnh hoặc chứa sai sót. Các bộ dữ liệu khổng lồ mà AI sử dụng để học hỏi có thể chứa những khoảng trống trong suy nghĩ, sự khác biệt về độ nổi bật của nội dung, hoặc thậm chí là các định kiến có hại. Những sai sót này có thể dẫn đến việc AI tạo ra thông tin không chính xác, ngay cả khi các bộ dữ liệu sau này đã được các nhà khoa học dữ liệu chỉnh sửa và cải thiện.

Ngoài ra, việc gán nhãn sai dữ liệu hoặc lỗi trong mã lập trình cũng có thể góp phần vào sự xuất hiện của AI hallucination. Việc khắc phục những vấn đề này là rất quan trọng vì AI phát triển dựa trên các thuật toán học máy, và những thuật toán này sử dụng dữ liệu để đưa ra quyết định. Mạng nơ-ron của AI, được xây dựng từ kinh nghiệm học máy, cố gắng mô phỏng sự sáng tạo của con người thông qua các transformer, giúp phân tích mối quan hệ giữa các điểm dữ liệu xa xôi. Khi các transformer này hoạt động không đúng cách, AI hallucination có thể xảy ra.

Cơ Hội Cho Tin Tặc Từ AI Hallucination

Người đeo mũ trùm đầu với khuôn mặt mờ

Người đeo mũ trùm đầu với khuôn mặt mờ

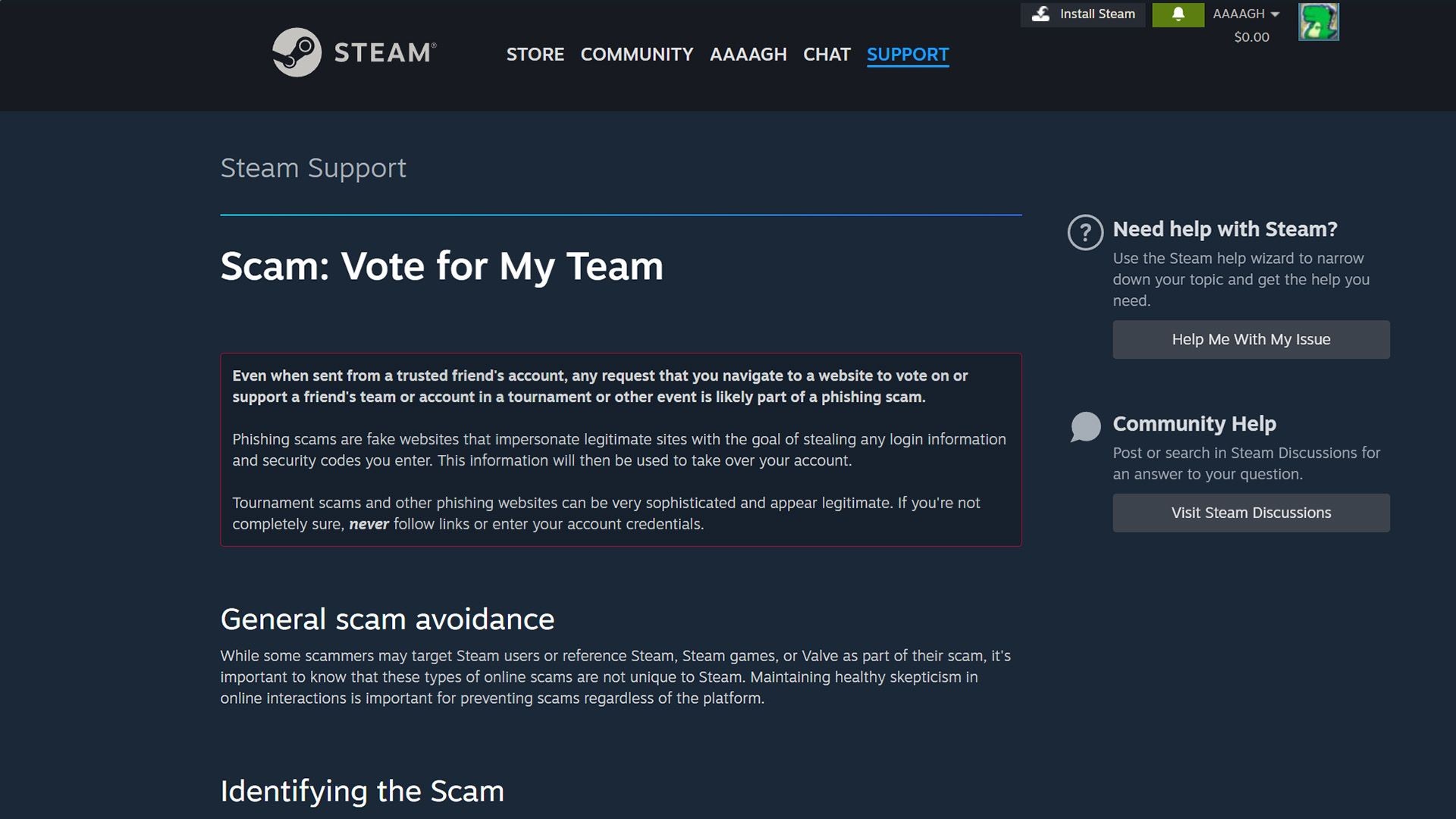

Một điều đáng lo ngại là không phải ai cũng biết về hiện tượng AI hallucination, và AI thường tỏ ra tự tin ngay cả khi cung cấp thông tin sai lệch. Điều này khiến người dùng dễ dàng tin tưởng vào AI và trở nên lơ là, tạo cơ hội cho các tin tặc lợi dụng. Ví dụ, một mô hình AI có thể tạo ra một thư viện mã giả và khuyến nghị người dùng tải xuống. Nếu tin tặc phát hiện ra điều này, họ có thể tạo ra một phiên bản thật của thư viện giả đó, nhưng chứa đầy mã độc và phần mềm độc hại. Khi AI tiếp tục khuyến nghị thư viện này, người dùng không biết gì sẽ tải xuống mã của tin tặc.

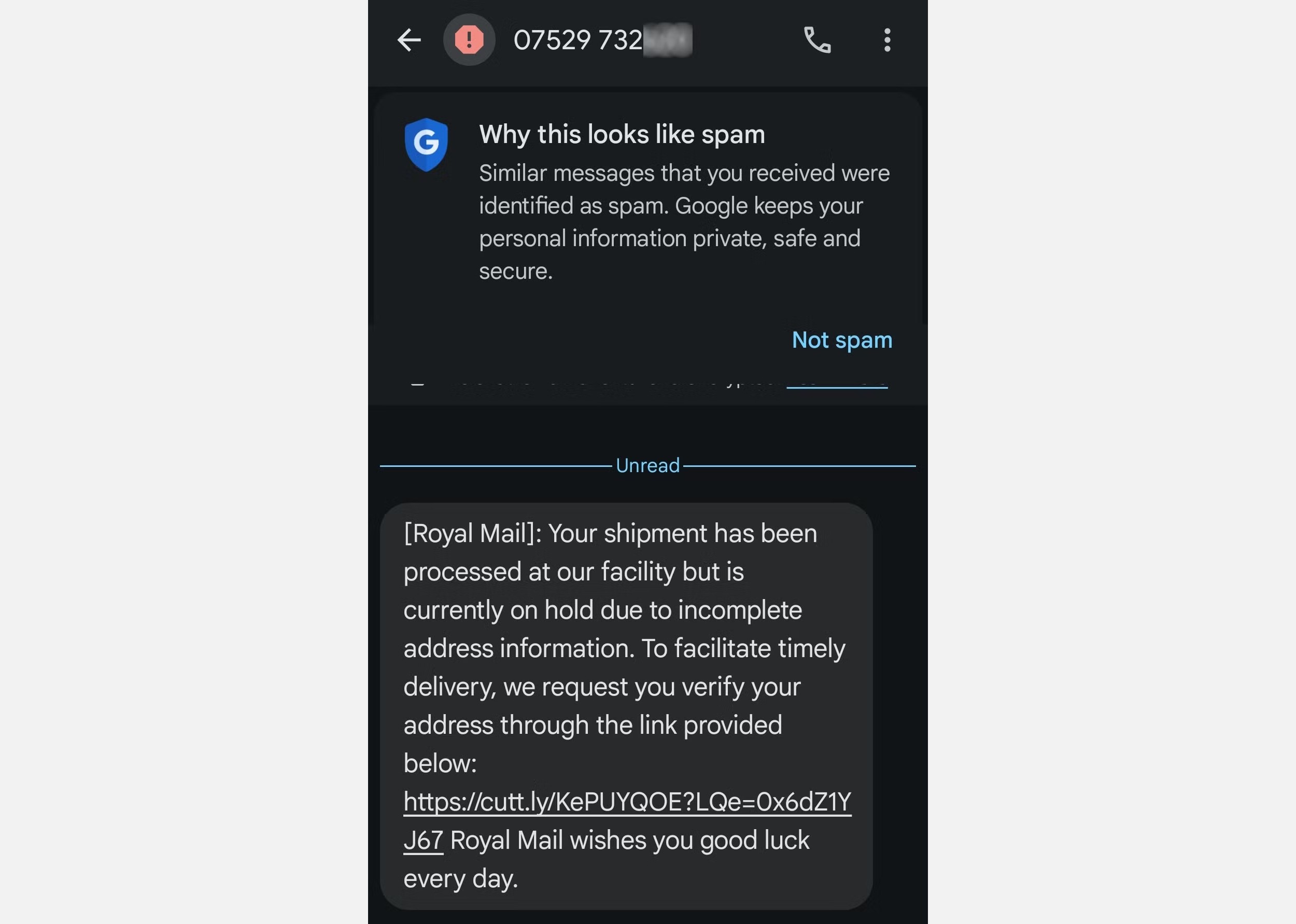

Việc vận chuyển mã độc và chương trình độc hại bằng cách lợi dụng AI hallucination là một bước đi tất yếu của các tin tặc. Họ không cần phải tạo ra vô số mối đe dọa mạng mới, mà chỉ cần tìm cách mới để gửi chúng mà không gây nghi ngờ. AI hallucination lợi dụng sự ngây thơ của con người, giống như việc nhấp vào liên kết trong email (đó là lý do tại sao bạn nên sử dụng công cụ kiểm tra liên kết để xác minh URL).

Tin tặc còn có thể nâng cấp chiến thuật của mình. Nếu bạn tìm kiếm sự giúp đỡ về mã và tải xuống mã giả, độc hại, tin tặc có thể làm cho mã này hoạt động như mong đợi, nhưng với một chương trình độc hại chạy ngầm. Việc mã hoạt động như bạn mong đợi không có nghĩa là nó không nguy hiểm.

Thiếu giáo dục có thể khuyến khích bạn tải xuống các khuyến nghị từ AI vì hành vi tự động trên mạng. Mọi lĩnh vực đều chịu áp lực văn hóa để áp dụng AI vào hoạt động kinh doanh của mình. Vô số tổ chức và ngành công nghiệp xa rời công nghệ đang thử nghiệm các công cụ AI với ít kinh nghiệm và an ninh mạng còn yếu kém chỉ để duy trì tính cạnh tranh.

Cách Bảo Vệ Bản Thân Khỏi AI Hallucination Được Vũ Khí Hóa

Cận cảnh màn hình máy tính với mã trên màn hình

Cận cảnh màn hình máy tính với mã trên màn hình

Tiến bộ đang đến gần. Việc tạo ra phần mềm độc hại bằng AI sinh ra đã dễ dàng trước khi các công ty điều chỉnh các bộ dữ liệu và điều khoản sử dụng để ngăn chặn các thế hệ không đạo đức. Biết được những điểm yếu xã hội, kỹ thuật và cá nhân mà bạn có thể gặp phải trước các ảo giác AI nguy hiểm, dưới đây là một số cách để giữ an toàn:

Bất kỳ ai trong ngành công nghiệp đều có thể làm việc để cải thiện công nghệ mạng nơ-ron và xác minh thư viện. Phải có sự kiểm tra và cân bằng trước khi phản hồi đến người dùng cuối. Mặc dù đây là một bước tiến cần thiết của ngành, bạn cũng có vai trò trong việc bảo vệ bản thân và người khác khỏi các mối đe dọa từ AI sinh ra.

Người dùng bình thường có thể thực hành nhận biết AI hallucination với các chiến lược sau:

- Tìm kiếm lỗi chính tả và ngữ pháp.

- Nhận thấy khi ngữ cảnh của câu hỏi không khớp với ngữ cảnh của câu trả lời.

- Nhận ra khi hình ảnh dựa trên thị giác máy tính không khớp với cách mắt người nhìn thấy khái niệm.

Luôn cẩn thận khi tải xuống nội dung từ internet, ngay cả khi được AI khuyến nghị. Nếu AI khuyến nghị tải xuống mã, đừng làm điều đó một cách mù quáng; kiểm tra bất kỳ đánh giá nào để đảm bảo mã là hợp pháp và tìm thông tin về người tạo.

Sự kháng cự tốt nhất chống lại các cuộc tấn công dựa trên AI hallucination là giáo dục. Nói về trải nghiệm của bạn và đọc cách người khác đã kích hoạt các ảo giác độc hại, dù vô tình hay cố ý thử nghiệm, là vô giá trong việc điều hướng AI trong tương lai.

Tăng Cường An Ninh Mạng Cho AI

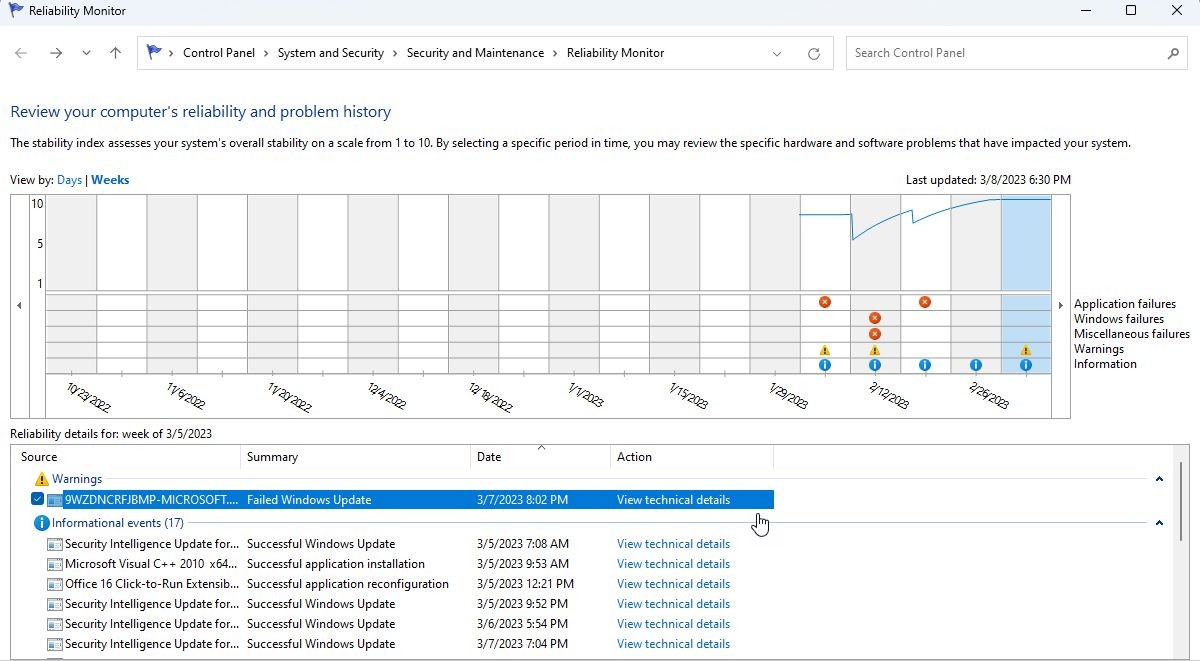

Bạn phải cẩn thận với những gì bạn yêu cầu khi nói chuyện với AI. Hạn chế tiềm năng của các kết quả nguy hiểm bằng cách cụ thể nhất có thể và đặt câu hỏi về bất cứ điều gì xuất hiện trên màn hình. Kiểm tra mã trong môi trường an toàn và kiểm tra thực tế các thông tin khác có vẻ đáng tin cậy. Ngoài ra, hợp tác với người khác, thảo luận về trải nghiệm của bạn và đơn giản hóa thuật ngữ về AI hallucination và các mối đe dọa an ninh mạng có thể giúp mọi người cảnh giác và kiên cường hơn trước tin tặc.

-

AI hallucination là gì?

AI hallucination là khi trí tuệ nhân tạo tạo ra thông tin sai lệch hoặc không chính xác. -

Tại sao AI lại có thể tạo ra thông tin sai lệch?

AI có thể tạo ra thông tin sai lệch do dữ liệu đào tạo không hoàn chỉnh hoặc chứa sai sót, lỗi trong mã lập trình, hoặc sự gán nhãn sai dữ liệu. -

Tin tặc có thể lợi dụng AI hallucination như thế nào?

Tin tặc có thể tạo ra các thư viện mã giả dựa trên AI hallucination và chèn mã độc vào đó, sau đó lợi dụng sự tin tưởng của người dùng vào AI để phát tán mã độc. -

Làm thế nào để nhận biết AI hallucination?

Bạn có thể nhận biết AI hallucination bằng cách tìm kiếm lỗi chính tả và ngữ pháp, kiểm tra sự không khớp giữa ngữ cảnh câu hỏi và câu trả lời, và so sánh hình ảnh do AI tạo ra với cách mắt người nhìn thấy. -

Cách tốt nhất để bảo vệ bản thân khỏi AI hallucination là gì?

Cách tốt nhất là giáo dục bản thân về AI hallucination, luôn kiểm tra thông tin từ AI, và cẩn thận khi tải xuống nội dung từ internet. -

Tại sao giáo dục lại quan trọng trong việc bảo vệ khỏi AI hallucination?

Giáo dục giúp bạn hiểu rõ hơn về AI hallucination, cách nhận biết và cách bảo vệ bản thân, từ đó giảm thiểu rủi ro từ các cuộc tấn công mạng. -

Làm thế nào để tăng cường an ninh mạng cho AI?

Bạn có thể tăng cường an ninh mạng cho AI bằng cách kiểm tra mã trong môi trường an toàn, kiểm tra thực tế thông tin từ AI, và hợp tác với người khác để chia sẻ kinh nghiệm và kiến thức.

Tham khảo thêm về an ninh mạng tại Tạp Chí Mobile

Trở về trang chủ Tạp Chí Mobile

Lưu ý: Bài viết này được viết dựa trên bài viết gốc từ MakeUseOf, với sự điều chỉnh và bổ sung để phù hợp với độc giả tiếng Việt và tối ưu hóa SEO.

Kết Luận

AI hallucination là một mối đe dọa thực sự trong thế giới công nghệ hiện đại, nhưng với sự hiểu biết và biện pháp bảo vệ phù hợp, bạn có thể giảm thiểu rủi ro. Hãy luôn cảnh giác, kiểm tra thông tin từ AI và giáo dục bản thân và người khác về những nguy cơ tiềm ẩn. Bằng cách này, bạn có thể giữ an toàn cho bản thân và tổ chức của mình trước các cuộc tấn công mạng từ AI hallucination.