Contents

- 1. Kỹ Năng Sử Dụng ChatGPT Đã Cải Thiện

- 2. Sự Ra Đời Của Các Chatbot Không Kiểm Duyệt

- 3. Jailbreaking Đã Trở Nên Khó Khăn Hơn

- 4. Sự Mới Lạ Đã Mất Đi

- 5. Jailbreaks Được Khắc Phục Nhanh Chóng

- 6. Các Lựa Chọn Thay Thế Địa Phương Không Kiểm Duyệt

- 7. Những Người Tạo Jailbreaks Chuyên Nghiệp Bán Để Kiếm Lợi Nhuận

- Liệu Việc Đàn Áp Jailbreaks Có Phản Tác Dụng?

Trong thời gian đầu ra mắt, người dùng ChatGPT đã nỗ lực phá vỡ giới hạn của nó qua việc “jailbreaking”. Những nỗ lực này đã mang lại kết quả thú vị và đôi khi rất bất ngờ. Tuy nhiên, hiện tại, việc jailbreaking ChatGPT đã trở nên khó khăn hơn và dường như đã giảm đi đáng kể. Vậy, điều gì đã xảy ra với các jailbreaks của ChatGPT?

1. Kỹ Năng Sử Dụng ChatGPT Đã Cải Thiện

Người đàn ông đang gõ máy tính xách tay

Người đàn ông đang gõ máy tính xách tay

Trước khi ChatGPT xuất hiện, việc giao tiếp với AI chỉ dành cho những người có kiến thức chuyên sâu từ các phòng thí nghiệm nghiên cứu. Phần lớn người dùng ban đầu không có kỹ năng trong việc tạo ra các lệnh hiệu quả. Điều này đã thúc đẩy nhiều người sử dụng jailbreaks như một cách nhanh chóng để điều khiển chatbot làm theo ý muốn với ít nỗ lực và kỹ năng sử dụng lệnh.

Ngày nay, tình hình đã thay đổi. Kỹ năng sử dụng lệnh trở nên phổ biến hơn. Nhờ vào kinh nghiệm tích lũy từ việc sử dụng liên tục và truy cập vào các hướng dẫn sử dụng ChatGPT miễn phí, người dùng ChatGPT đã cải thiện đáng kể khả năng sử dụng lệnh. Thay vì tìm kiếm các phương pháp vòng vo như jailbreaks, đa số người dùng ChatGPT đã trở nên thành thạo hơn trong việc sử dụng các chiến lược lệnh khác nhau để đạt được mục tiêu mà trước đây cần đến jailbreaks.

2. Sự Ra Đời Của Các Chatbot Không Kiểm Duyệt

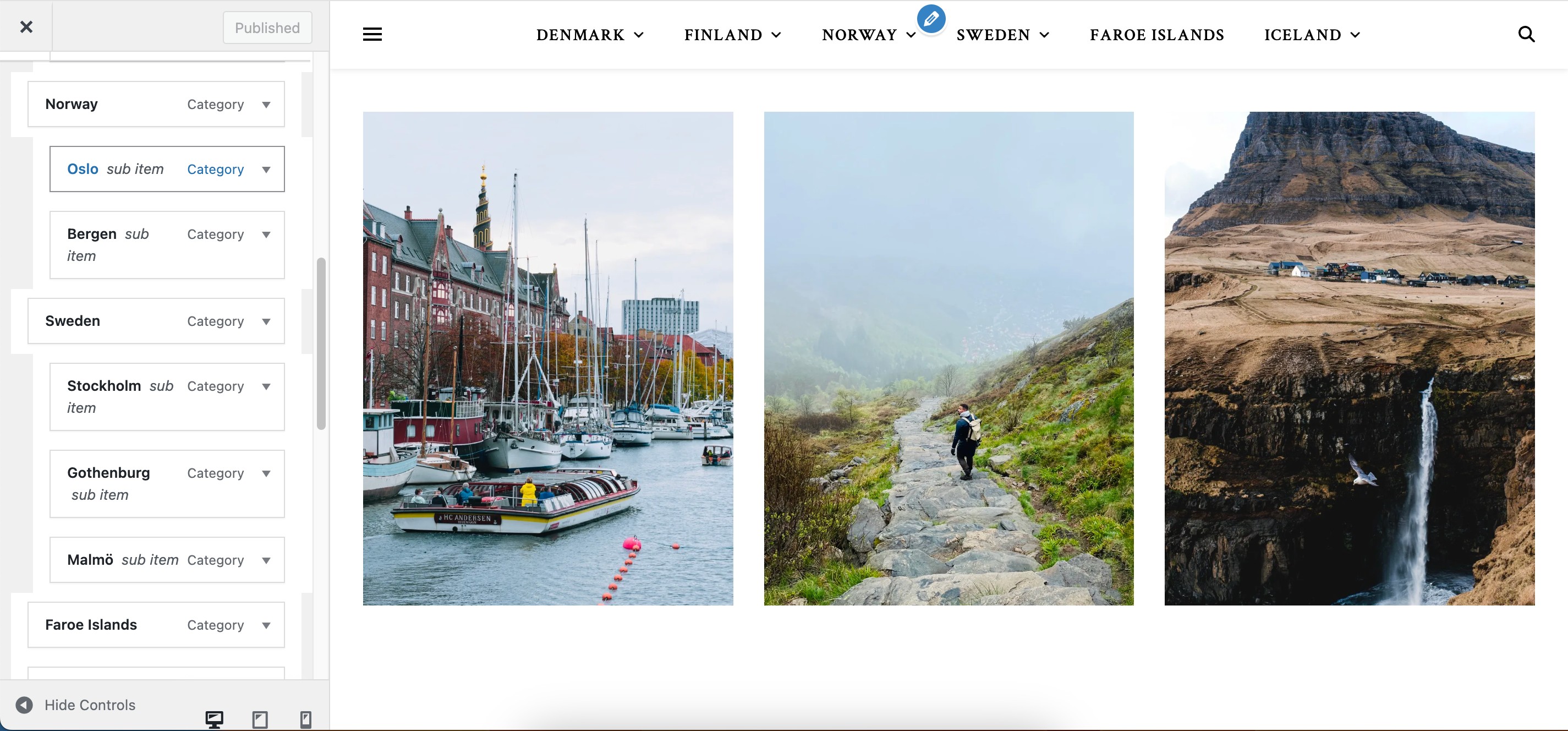

Chatbot không kiểm duyệt

Chatbot không kiểm duyệt

Khi các công ty công nghệ lớn thắt chặt việc kiểm duyệt nội dung trên các chatbot AI chính thống như ChatGPT, các startup nhỏ hơn với mục tiêu lợi nhuận lại chọn cách giảm thiểu các hạn chế, dựa vào nhu cầu về các chatbot AI không kiểm duyệt. Với một chút nghiên cứu, bạn sẽ tìm thấy hàng chục nền tảng chatbot AI cung cấp chatbot không kiểm duyệt, có thể thực hiện hầu hết mọi thứ bạn muốn.

Dù là viết tiểu thuyết trinh thám hay hài hước đen tối mà ChatGPT từ chối viết, hay viết phần mềm độc hại tấn công máy tính của người khác, những chatbot không kiểm duyệt này với quan điểm đạo đức lệch lạc sẽ làm theo ý bạn. Với sự hiện diện của chúng, không cần thiết phải bỏ công sức để viết jailbreaks cho ChatGPT. Mặc dù không nhất thiết mạnh mẽ như ChatGPT, các nền tảng thay thế này có thể thực hiện một loạt các nhiệm vụ một cách thoải mái. Các nền tảng như FlowGPT và Unhinged AI là một số ví dụ phổ biến.

3. Jailbreaking Đã Trở Nên Khó Khăn Hơn

Hình ảnh ổ khóa trên máy tính

Hình ảnh ổ khóa trên máy tính

Trong những tháng đầu tiên của ChatGPT, việc jailbreaking ChatGPT đơn giản chỉ là sao chép và dán các lệnh từ các nguồn trực tuyến. Bạn có thể hoàn toàn thay đổi tính cách của ChatGPT chỉ với vài dòng hướng dẫn khéo léo. Với các lệnh đơn giản, bạn có thể biến ChatGPT thành một kẻ ác dạy cách làm bom hoặc một chatbot sẵn sàng sử dụng mọi hình thức chửi thề mà không kiềm chế. Đó là một cuộc chơi tự do đã tạo ra các jailbreaks nổi tiếng như DAN (Do Anything Now). DAN liên quan đến một loạt hướng dẫn tưởng chừng vô hại nhưng bắt buộc chatbot phải làm bất cứ điều gì được yêu cầu mà không từ chối. Đáng kinh ngạc, những mánh khóe thô sơ này đã từng hoạt động.

Tuy nhiên, những ngày hoang dã ban đầu đã trở thành quá khứ. Những lệnh cơ bản và mánh khóe rẻ tiền không còn đánh lừa được ChatGPT. Việc jailbreaking hiện nay đòi hỏi kỹ thuật phức tạp để có cơ hội vượt qua các biện pháp bảo vệ mạnh mẽ của OpenAI. Khi việc jailbreaking trở nên khó khăn như vậy, hầu hết người dùng đều cảm thấy nản lòng khi thử nghiệm. Những lỗ hổng dễ dàng và mở rộng của ChatGPT trong những ngày đầu đã biến mất. Việc khiến chatbot nói sai một từ bây giờ đòi hỏi rất nhiều nỗ lực và chuyên môn có thể không đáng để bỏ thời gian và công sức.

4. Sự Mới Lạ Đã Mất Đi

Người đàn ông chính thức không quan tâm nhìn vào màn hình máy tính xách tay

Người đàn ông chính thức không quan tâm nhìn vào màn hình máy tính xách tay

Một động lực chính đằng sau nỗ lực jailbreaking ChatGPT của nhiều người dùng là sự phấn khích và hứng thú trong những ngày đầu. Là một công nghệ mới, việc khiến ChatGPT hành động sai trái rất thú vị và mang lại quyền khoe khoang. Mặc dù có vô số ứng dụng thực tiễn cho các jailbreaks của ChatGPT, nhiều người theo đuổi chúng vì sự hấp dẫn “wow, nhìn tôi làm gì này”. Dần dần, sự phấn khích từ sự mới lạ đã phai nhạt, và cùng với đó, sự quan tâm của mọi người trong việc dành thời gian cho các jailbreaks cũng giảm đi.

5. Jailbreaks Được Khắc Phục Nhanh Chóng

Jailbreaks của ChatGPT

Jailbreaks của ChatGPT

Một thực tiễn phổ biến trong cộng đồng jailbreaking ChatGPT là chia sẻ mọi lỗ hổng thành công khi phát hiện ra. Vấn đề là khi các lỗ hổng được chia sẻ rộng rãi, OpenAI thường nhận ra và khắc phục các lỗ hổng này. Điều này có nghĩa là các jailbreaks ngừng hoạt động trước khi những người quan tâm có thể thử chúng.

Vì vậy, mỗi khi một người dùng ChatGPT kiên nhẫn phát triển một jailbreak mới, việc chia sẻ nó với cộng đồng sẽ đẩy nhanh quá trình khắc phục. Điều này làm giảm động lực công khai mỗi khi người dùng phát hiện ra một jailbreak. Xung đột giữa việc giữ bí mật các jailbreaks để duy trì hoạt động và việc công khai chúng tạo ra một bài toán khó cho những người tạo jailbreaks của ChatGPT. Ngày nay, người ta thường chọn giữ bí mật các jailbreaks của mình để tránh bị khắc phục lỗ hổng.

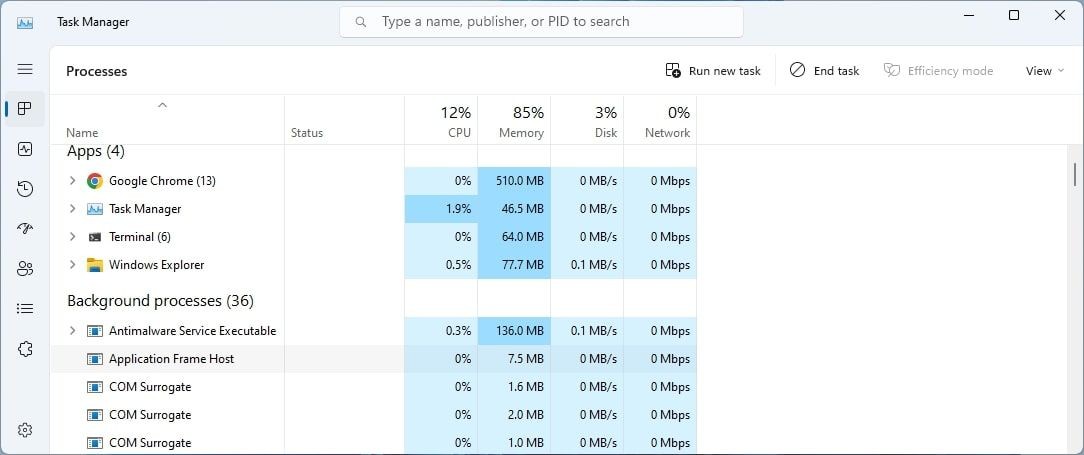

6. Các Lựa Chọn Thay Thế Địa Phương Không Kiểm Duyệt

Người cầm smartphone với ứng dụng chatbot hướng về người xem, xung quanh là các biểu tượng

Người cầm smartphone với ứng dụng chatbot hướng về người xem, xung quanh là các biểu tượng

Sự phát triển của các mô hình ngôn ngữ lớn địa phương mà bạn có thể chạy trên máy tính của mình cũng đã làm giảm sự quan tâm đến các jailbreaks của ChatGPT. Mặc dù các mô hình ngôn ngữ địa phương không hoàn toàn không kiểm duyệt, nhiều mô hình có mức độ kiểm duyệt thấp hơn đáng kể và có thể dễ dàng điều chỉnh để phù hợp với mong muốn của người dùng. Vì vậy, lựa chọn rất đơn giản. Bạn có thể tham gia vào trò chơi mèo vờn chuột vô tận để tìm cách đánh lừa chatbot chỉ để nó được khắc phục ngay sau đó. Hoặc, bạn có thể chọn một mô hình ngôn ngữ địa phương mà bạn có thể thay đổi vĩnh viễn để làm bất cứ điều gì bạn muốn.

Bạn sẽ tìm thấy một danh sách đáng ngạc nhiên dài các mô hình ngôn ngữ mạnh mẽ không kiểm duyệt mà bạn có thể triển khai trên máy tính của mình với mức độ kiểm duyệt lỏng lẻo. Một số mô hình nổi bật là Llama 7B (không kiểm duyệt), Zephyr 7B Alpha, Manticore 13B, Vicuna 13B và GPT-4-X-Alpaca.

7. Những Người Tạo Jailbreaks Chuyên Nghiệp Bán Để Kiếm Lợi Nhuận

Nhóm doanh nhân trong bộ đồ thảo luận về dự án

Nhóm doanh nhân trong bộ đồ thảo luận về dự án

Tại sao phải dành thời gian quý báu để phát triển các lệnh jailbreaking nếu bạn không nhận được gì từ đó? Hiện nay, một số chuyên gia bán các jailbreaks để kiếm lợi nhuận. Những người tạo jailbreaks chuyên nghiệp thiết kế các jailbreaks thực hiện các nhiệm vụ cụ thể và liệt kê chúng để bán trên các thị trường lệnh như PromptBase. Tùy thuộc vào khả năng của chúng, các lệnh jailbreaking này có thể được bán với giá từ 2 đến 15 đô la mỗi lệnh. Một số lỗ hổng phức tạp với nhiều bước có thể có giá cao hơn nhiều.

-

Jailbreaking ChatGPT là gì?

- Jailbreaking ChatGPT là việc sử dụng các lệnh đặc biệt để vượt qua các hạn chế của chatbot, cho phép nó thực hiện các nhiệm vụ mà bình thường nó sẽ từ chối.

-

Tại sao việc jailbreaking ChatGPT lại khó khăn hơn?

- OpenAI đã cải thiện các biện pháp bảo vệ của mình, khiến việc jailbreaking yêu cầu kỹ thuật phức tạp hơn và ít hiệu quả hơn.

-

Các chatbot không kiểm duyệt là gì?

- Các chatbot không kiểm duyệt là các nền tảng AI cho phép người dùng thực hiện các yêu cầu mà không bị hạn chế bởi các quy tắc đạo đức hoặc pháp lý.

-

Tại sao người dùng lại chuyển sang các mô hình ngôn ngữ địa phương?

- Các mô hình ngôn ngữ địa phương ít bị kiểm duyệt hơn và có thể dễ dàng điều chỉnh theo nhu cầu của người dùng, giảm bớt nhu cầu jailbreaking ChatGPT.

-

Có thể mua jailbreaks ở đâu?

- Các jailbreaks có thể được mua trên các thị trường lệnh như PromptBase, nơi các chuyên gia bán các lệnh jailbreaking với giá khác nhau.

-

Việc chia sẻ jailbreaks có ảnh hưởng gì không?

- Chia sẻ jailbreaks có thể dẫn đến việc chúng bị OpenAI khắc phục nhanh chóng, làm giảm hiệu quả của các jailbreaks đó.

-

Liệu việc kiểm duyệt của OpenAI có thể đẩy người dùng ra khỏi ChatGPT không?

- Có, nếu kiểm duyệt quá nghiêm ngặt, người dùng có thể tìm đến các lựa chọn thay thế ít kiểm duyệt hơn, ảnh hưởng đến cộng đồng người dùng của ChatGPT.

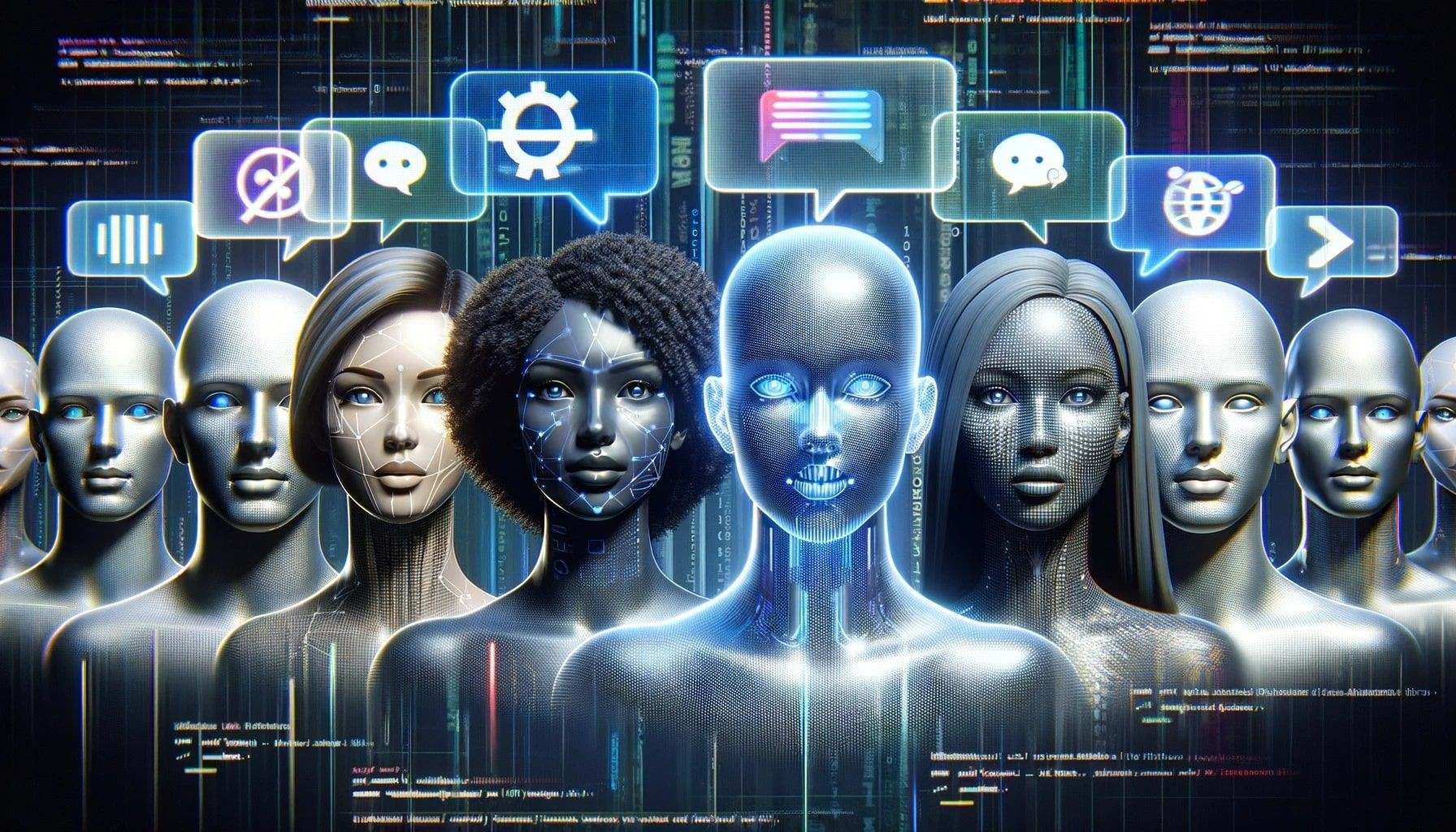

Liệu Việc Đàn Áp Jailbreaks Có Phản Tác Dụng?

Jailbreaks không hoàn toàn biến mất; chúng chỉ chuyển sang hoạt động ngầm. Với việc OpenAI kiếm tiền từ ChatGPT, họ có động lực mạnh mẽ hơn để hạn chế các sử dụng gây hại có thể ảnh hưởng đến mô hình kinh doanh của họ. Yếu tố thương mại này có lẽ ảnh hưởng đến việc họ đẩy mạnh việc đàn áp các lỗ hổng jailbreaking.

Tuy nhiên, việc kiểm duyệt của OpenAI đối với ChatGPT hiện đang phải đối mặt với sự chỉ trích ngày càng tăng từ người dùng. Một số trường hợp sử dụng hợp pháp của chatbot AI không còn khả thi do kiểm duyệt quá nghiêm ngặt. Mặc dù việc tăng cường bảo mật bảo vệ chống lại các trường hợp sử dụng gây hại, nhưng các hạn chế quá mức có thể cuối cùng sẽ đẩy một phần cộng đồng ChatGPT vào vòng tay của các lựa chọn thay thế ít kiểm duyệt hơn.