Contents

Trong tháng 1 năm 2023, chỉ hai tháng sau khi ra mắt, ChatGPT (Generative Pre-trained Transformer) đã trở thành ứng dụng phát triển nhanh nhất mọi thời đại, thu hút hơn 100 triệu người dùng. Sự xuất hiện của chatbot tiên tiến từ OpenAI có thể đã khơi dậy sự quan tâm của công chúng đối với trí tuệ nhân tạo, nhưng ít ai thực sự cân nhắc đến những rủi ro an ninh tiềm ẩn liên quan đến sản phẩm này.

Công Nghệ Đằng Sau ChatGPT và Các Mối Đe Dọa An Ninh

Công nghệ nền tảng của ChatGPT và các chatbot khác có thể tương tự nhau, nhưng ChatGPT nằm trong một hạng mục riêng biệt. Điều này là tin vui nếu bạn dự định sử dụng nó như một trợ lý cá nhân, nhưng lại đáng lo ngại nếu bạn nghĩ rằng các tác nhân đe dọa cũng sử dụng nó.

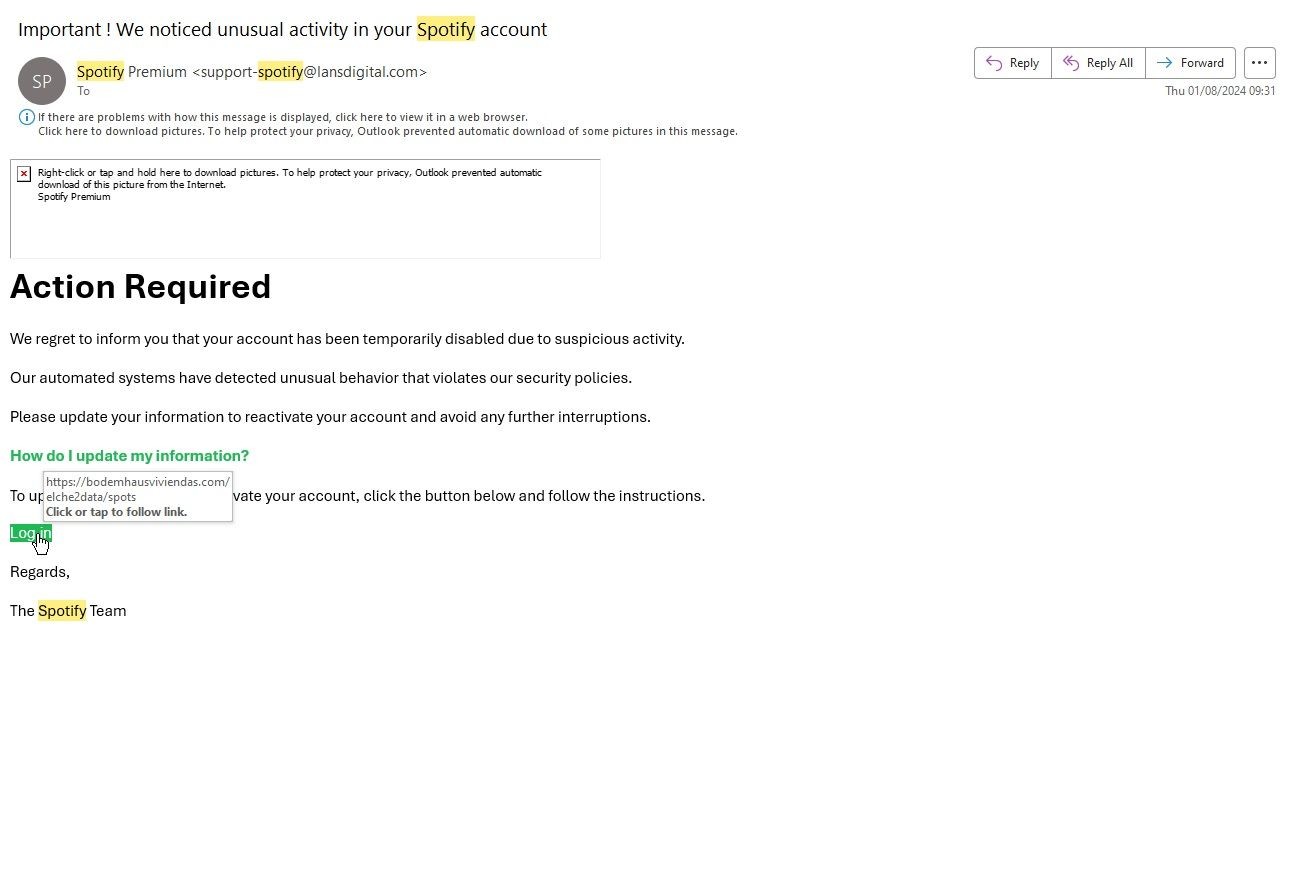

Tội phạm mạng có thể sử dụng ChatGPT để viết phần mềm độc hại, xây dựng các trang web lừa đảo, tạo ra email phishing, tạo tin tức giả mạo, và nhiều hơn nữa. Vì lý do này, ChatGPT có thể là một rủi ro an ninh mạng lớn hơn là lợi ích, như Bleeping Computer đã phân tích.

Đồng thời, có những lo ngại nghiêm trọng rằng chính ChatGPT cũng có những lỗ hổng chưa được giải quyết. Ví dụ, vào tháng 3 năm 2023, có báo cáo về việc một số người dùng có thể xem tiêu đề của cuộc trò chuyện của người khác. Như The Verge đã đưa tin vào thời điểm đó, CEO của OpenAI, Sam Altman, giải thích rằng “một lỗi trong thư viện mã nguồn mở” đã gây ra vấn đề này.

Điều này chỉ nhấn mạnh tầm quan trọng của việc hạn chế những gì bạn chia sẻ với ChatGPT, vốn thu thập một lượng dữ liệu khổng lồ theo mặc định. Tập đoàn công nghệ khổng lồ Samsung đã học được bài học này một cách khó khăn, khi một nhóm nhân viên sử dụng chatbot như một trợ lý đã vô tình rò rỉ thông tin mật cho nó.

ChatGPT: Mối Đe Dọa Đối Với Quyền Riêng Tư Của Bạn?

Logo ChatGPT trên nền xanh

Logo ChatGPT trên nền xanh

An ninh và quyền riêng tư không phải là một, nhưng chúng có mối liên hệ chặt chẽ và thường giao thoa. Nếu ChatGPT là một mối đe dọa an ninh, thì nó cũng là một mối đe dọa đối với quyền riêng tư, và ngược lại. Nhưng điều này có ý nghĩa gì trong thực tế? Chính sách an ninh và quyền riêng tư của ChatGPT như thế nào?

Hàng tỷ từ đã được thu thập từ internet để tạo ra cơ sở dữ liệu rộng lớn của ChatGPT. Cơ sở dữ liệu này luôn trong trạng thái mở rộng liên tục, vì ChatGPT lưu trữ bất cứ điều gì người dùng chia sẻ. Tổ chức phi lợi nhuận có trụ sở tại Mỹ Common Sense đã đánh giá quyền riêng tư của ChatGPT với điểm số 61%, lưu ý rằng chatbot này thu thập Thông tin Nhận dạng Cá nhân (PII) và các dữ liệu nhạy cảm khác. Hầu hết dữ liệu này được lưu trữ hoặc chia sẻ với một số bên thứ ba.

Dù sao đi nữa, bạn nên cẩn thận khi sử dụng ChatGPT, đặc biệt là nếu bạn sử dụng nó cho công việc, hoặc để xử lý thông tin nhạy cảm. Là một nguyên tắc chung, bạn không nên chia sẻ với bot những gì bạn không muốn công chúng biết.

Giải Quyết Các Rủi Ro An Ninh Liên Quan Đến ChatGPT

Trí tuệ nhân tạo sẽ được quy định vào một thời điểm nào đó, nhưng thật khó để tưởng tượng một thế giới mà nó không gây ra mối đe dọa an ninh. Giống như tất cả các công nghệ, nó có thể – và sẽ – bị lạm dụng.

Trong tương lai, chatbot sẽ trở thành một phần không thể thiếu của các công cụ tìm kiếm, trợ lý giọng nói và mạng xã hội, theo Malwarebytes. Và chúng sẽ đóng vai trò trong nhiều ngành công nghiệp, từ y tế và giáo dục, đến tài chính và giải trí.

Điều này sẽ thay đổi hoàn toàn khái niệm về an ninh như chúng ta biết. Nhưng như Malwarebytes cũng lưu ý, ChatGPT và các công cụ tương tự cũng có thể được sử dụng bởi các chuyên gia an ninh mạng; ví dụ để tìm kiếm lỗi trong phần mềm, hoặc “các mẫu đáng ngờ” trong hoạt động mạng.

-

ChatGPT có an toàn để sử dụng không?

- ChatGPT có thể an toàn nếu bạn cẩn thận với thông tin bạn chia sẻ. Tuy nhiên, nó có những rủi ro an ninh và quyền riêng tư tiềm ẩn mà bạn nên lưu ý.

-

Tội phạm mạng có thể sử dụng ChatGPT như thế nào?

- Tội phạm mạng có thể sử dụng ChatGPT để viết phần mềm độc hại, tạo ra các trang web lừa đảo, gửi email phishing, và tạo tin tức giả mạo.

-

Làm thế nào để bảo vệ quyền riêng tư khi sử dụng ChatGPT?

- Hãy hạn chế chia sẻ thông tin nhạy cảm và cá nhân với ChatGPT. Đừng chia sẻ những gì bạn không muốn công chúng biết.

-

ChatGPT có thể bị lạm dụng như thế nào?

- ChatGPT có thể bị lạm dụng để thực hiện các hành vi phạm tội mạng như lừa đảo, tấn công mạng, và phát tán thông tin sai lệch.

-

Tương lai của chatbot như ChatGPT sẽ như thế nào?

- Chatbot như ChatGPT sẽ trở thành một phần không thể thiếu của nhiều ngành công nghiệp và công nghệ, nhưng cũng sẽ đặt ra những thách thức về an ninh và quyền riêng tư.

-

Làm thế nào để các chuyên gia an ninh mạng sử dụng ChatGPT?

- Các chuyên gia an ninh mạng có thể sử dụng ChatGPT để tìm kiếm lỗi trong phần mềm và phát hiện các mẫu hoạt động mạng đáng ngờ.

-

Tại sao việc nâng cao nhận thức về rủi ro an ninh của AI lại quan trọng?

- Nâng cao nhận thức giúp các ngành công nghiệp và người dùng hiểu rõ hơn về các rủi ro và sử dụng công nghệ AI một cách có trách nhiệm và đạo đức.

Nâng Cao Nhận Thức Là Chìa Khóa

ChatGPT sẽ có khả năng gì trong năm hoặc mười năm tới? Chúng ta chỉ có thể đoán, nhưng điều chúng ta biết chắc chắn là trí tuệ nhân tạo sẽ không đi đâu cả.

Khi các chatbot tiên tiến hơn xuất hiện, toàn bộ các ngành công nghiệp sẽ phải điều chỉnh và học cách sử dụng chúng một cách có trách nhiệm. Điều này bao gồm cả ngành công nghiệp an ninh mạng, vốn đã đang bị ảnh hưởng bởi AI. Nâng cao nhận thức về các rủi ro an ninh liên quan đến AI là chìa khóa, và sẽ giúp đảm bảo rằng các công nghệ này được phát triển và sử dụng một cách đạo đức.