Contents

- Chat with RTX Là Gì?

- Yêu Cầu Hệ Thống Để Cài Đặt Chat with RTX

- Bước 1: Tải Xuống Chat with RTX

- Bước 2: Giải Nén Tệp ZIP

- Bước 3: Cài Đặt Chat with RTX

- Hướng Dẫn Sử Dụng Chat with RTX

- Bước 1: Tạo Thư Mục RAG

- Bước 2: Thiết Lập Môi Trường

- Bước 3: Đặt Câu Hỏi Cho Chat with RTX

- Bước 4: Tính Năng Bổ Sung

- Đánh Giá Hiệu Quả Của Chat with RTX

- Giải Pháp Thay Thế Nếu Bạn Không Có GPU RTX 30 hoặc 40 Series

- 1. Chat with RTX có thể hoạt động mà không cần kết nối Internet không?

- 2. Tôi cần loại GPU nào để chạy Chat with RTX?

- 3. Chat with RTX có thể đọc và phân tích các tệp dữ liệu của tôi không?

- 4. Tôi có thể sử dụng Chat with RTX để phân tích video trên YouTube không?

- 5. Chat with RTX có an toàn để sử dụng với dữ liệu nhạy cảm không?

- 6. Chat with RTX có thể được sử dụng để tạo mã lập trình không?

- 7. Phiên bản hiện tại của Chat with RTX có phải là phiên bản cuối cùng không?

- Kết Luận

Trong thời đại công nghệ phát triển không ngừng, việc sử dụng trí tuệ nhân tạo (AI) ngày càng trở nên phổ biến. Một trong những công cụ đáng chú ý là Chat with RTX của Nvidia, một chatbot AI hoạt động trực tiếp trên máy tính cá nhân của bạn. Bài viết này sẽ hướng dẫn bạn cách tải và cài đặt Chat with RTX, đồng thời đánh giá hiệu quả của nó trong việc cung cấp trải nghiệm AI tối ưu.

Chat with RTX Là Gì?

Chat with RTX là phần mềm AI cho phép bạn chạy mô hình ngôn ngữ lớn (LLM) ngay trên máy tính của mình. Thay vì sử dụng chatbot AI trực tuyến như ChatGPT, bạn có thể sử dụng Chat with RTX offline bất cứ lúc nào. Phần mềm này sử dụng TensorRT-LLM, RTX acceleration, và mô hình Mistral 7-B LLM đã được tối ưu hóa để cung cấp hiệu suất nhanh chóng và câu trả lời chất lượng không thua kém các chatbot AI trực tuyến khác. Đặc biệt, Chat with RTX còn hỗ trợ retrieval-augmented generation (RAG), cho phép chatbot đọc qua các tệp của bạn và cung cấp câu trả lời tùy chỉnh dựa trên dữ liệu bạn cung cấp, mang đến trải nghiệm cá nhân hóa hơn.

Yêu Cầu Hệ Thống Để Cài Đặt Chat with RTX

Để cài đặt và sử dụng Chat with RTX, máy tính của bạn cần đáp ứng các yêu cầu tối thiểu sau:

- GPU RTX 30-Series hoặc 40-Series

- 16GB RAM

- 100GB dung lượng lưu trữ trống

- Hệ điều hành Windows 11

Nếu máy tính của bạn đáp ứng các yêu cầu trên, bạn có thể tiến hành cài đặt như sau:

Bước 1: Tải Xuống Chat with RTX

Bạn có thể tải xuống tệp ZIP của Chat with RTX từ trang web chính thức của Nvidia.

- Tải xuống: Chat with RTX (Miễn phí—35GB)

Bước 2: Giải Nén Tệp ZIP

Sau khi tải xuống, hãy giải nén tệp ZIP bằng cách nhấp chuột phải và chọn công cụ giải nén như 7Zip hoặc nhấp đúp vào tệp và chọn Extract All.

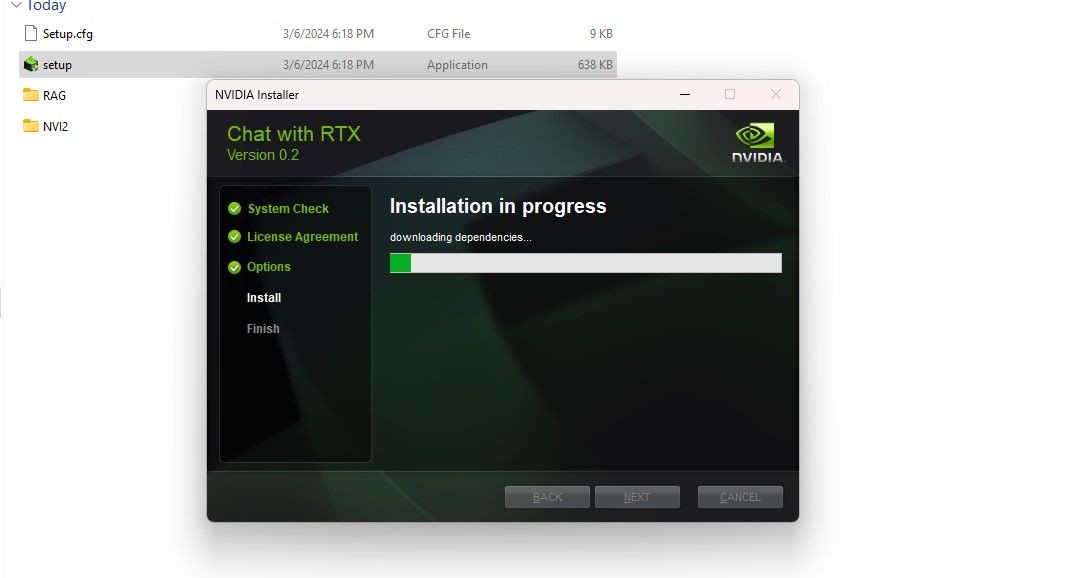

Bước 3: Cài Đặt Chat with RTX

Mở thư mục đã giải nén và nhấp đúp vào setup.exe. Làm theo hướng dẫn trên màn hình và chọn tất cả các tùy chọn trong quá trình cài đặt tùy chỉnh. Sau khi nhấn Next, trình cài đặt sẽ tải xuống và cài đặt LLM cùng tất cả các phụ thuộc cần thiết.

Quá trình cài đặt Chat with RTX

Quá trình cài đặt Chat with RTX

Quá trình cài đặt sẽ mất một khoảng thời gian để hoàn thành do lượng dữ liệu lớn cần tải xuống và cài đặt. Sau khi hoàn tất, nhấn Close và bạn đã sẵn sàng để sử dụng ứng dụng.

Hướng Dẫn Sử Dụng Chat with RTX

Mặc dù bạn có thể sử dụng Chat with RTX như một chatbot AI trực tuyến thông thường, tôi khuyên bạn nên kiểm tra chức năng RAG của nó, giúp bạn tùy chỉnh kết quả dựa trên các tệp bạn cung cấp.

Bước 1: Tạo Thư Mục RAG

Để bắt đầu sử dụng RAG trên Chat with RTX, hãy tạo một thư mục mới để lưu trữ các tệp bạn muốn AI phân tích.

Sau khi tạo thư mục, đặt các tệp dữ liệu của bạn vào đó. Dữ liệu bạn lưu trữ có thể bao gồm nhiều chủ đề và loại tệp khác nhau như tài liệu, PDF, văn bản và video. Tuy nhiên, bạn nên giới hạn số lượng tệp trong thư mục này để không ảnh hưởng đến hiệu suất. Càng nhiều dữ liệu cần tìm kiếm, Chat with RTX sẽ càng mất nhiều thời gian để trả lời các truy vấn cụ thể (nhưng điều này cũng phụ thuộc vào phần cứng).

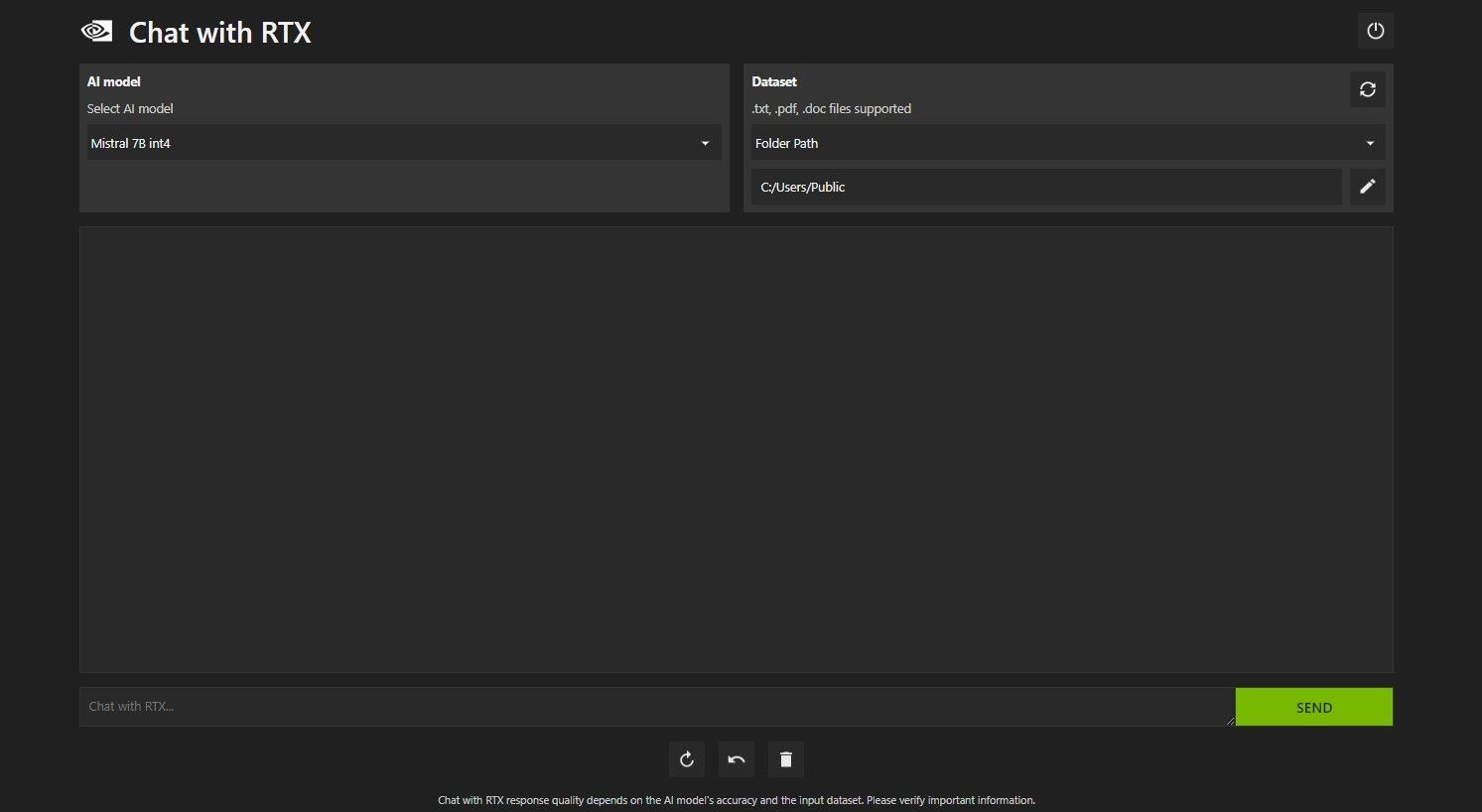

Giao diện web của Chat with RTX

Giao diện web của Chat with RTX

Bước 2: Thiết Lập Môi Trường

Mở Chat with RTX. Giao diện sẽ trông như hình dưới đây.

Dưới Dataset, đảm bảo rằng tùy chọn Folder Path được chọn. Sau đó nhấp vào biểu tượng chỉnh sửa bên dưới (biểu tượng cây bút) và chọn thư mục chứa tất cả các tệp bạn muốn Chat with RTX đọc. Bạn cũng có thể thay đổi mô hình AI nếu có các tùy chọn khác (tại thời điểm viết bài, chỉ có Mistral 7B có sẵn).

Bạn đã sẵn sàng để sử dụng Chat with RTX.

Bước 3: Đặt Câu Hỏi Cho Chat with RTX

Có nhiều cách để truy vấn Chat with RTX. Cách đầu tiên là sử dụng nó như một chatbot AI thông thường. Tôi đã hỏi Chat with RTX về lợi ích của việc sử dụng LLM cục bộ và hài lòng với câu trả lời của nó. Câu trả lời không quá chi tiết nhưng đủ chính xác.

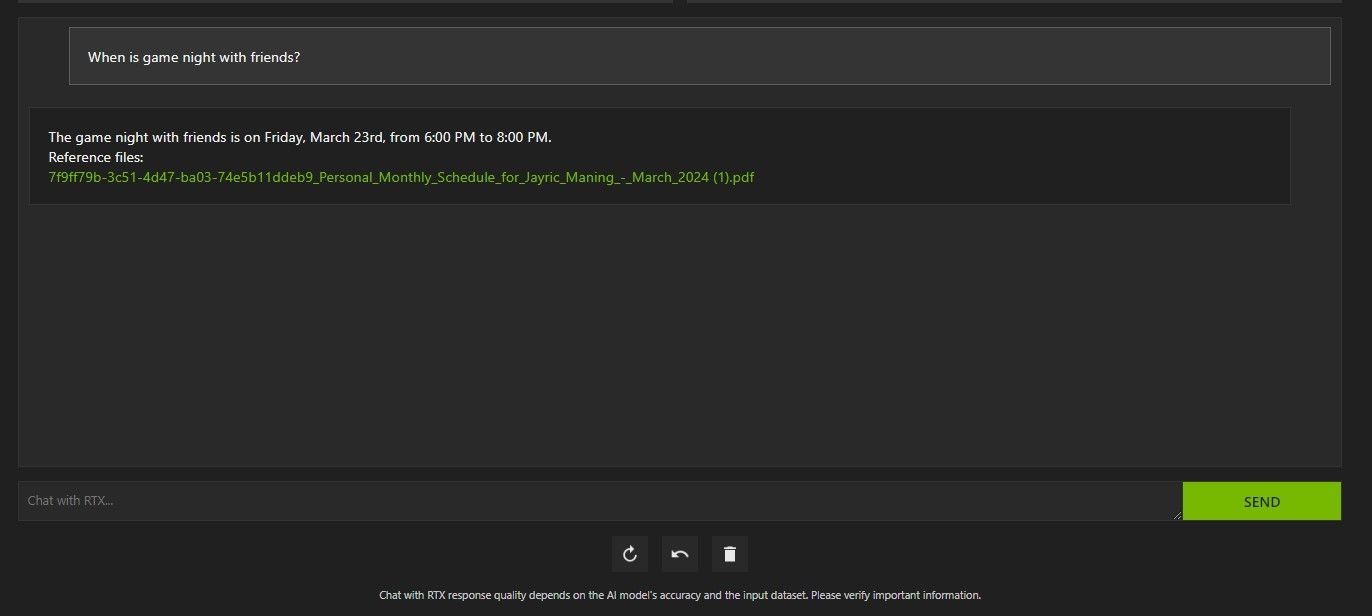

Đặt câu hỏi cá nhân cho Chat with RTX

Đặt câu hỏi cá nhân cho Chat with RTX

Nhưng vì Chat with RTX có khả năng RAG, bạn cũng có thể sử dụng nó như một trợ lý AI cá nhân.

Trong hình trên, tôi đã sử dụng Chat with RTX để hỏi về lịch trình của mình. Dữ liệu đến từ một tệp PDF chứa lịch trình, lịch làm việc, sự kiện và các thông tin khác. Trong trường hợp này, Chat with RTX đã lấy đúng dữ liệu lịch từ tệp dữ liệu; bạn sẽ cần cập nhật các tệp dữ liệu và ngày lịch để tính năng này hoạt động đúng cho đến khi có sự tích hợp với các ứng dụng khác.

Bạn có thể sử dụng RAG của Chat with RTX theo nhiều cách khác nhau. Ví dụ, bạn có thể sử dụng nó để đọc qua các tài liệu pháp lý và tóm tắt, tạo mã liên quan đến chương trình bạn đang phát triển, lấy các điểm nổi bật về video mà bạn quá bận để xem, và nhiều hơn nữa!

Bước 4: Tính Năng Bổ Sung

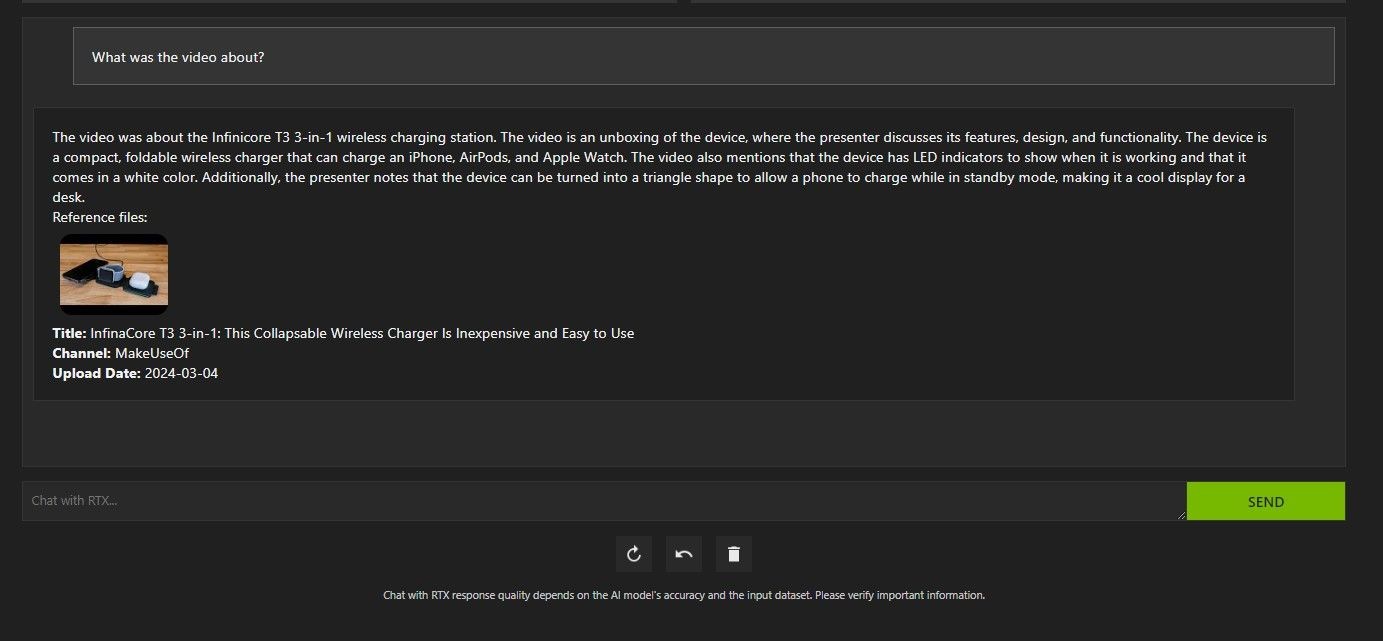

Ngoài thư mục dữ liệu cục bộ, bạn có thể sử dụng Chat with RTX để phân tích các video trên YouTube. Để làm điều này, dưới Dataset, thay đổi Folder Path thành YouTube URL.

Sử dụng Chat with RTX để tóm tắt video YouTube

Sử dụng Chat with RTX để tóm tắt video YouTube

Sao chép URL YouTube bạn muốn phân tích và dán nó dưới menu thả xuống. Sau đó, bạn có thể đặt câu hỏi!

Phân tích video YouTube của Chat with RTX khá tốt và cung cấp thông tin chính xác, vì vậy nó có thể hữu ích cho nghiên cứu, phân tích nhanh và nhiều hơn nữa.

Đánh Giá Hiệu Quả Của Chat with RTX

Chat with RTX có khả năng cung cấp chức năng RAG mà không cần gửi tệp của bạn lên máy chủ của bên thứ ba. Điều này đảm bảo dữ liệu nhạy cảm của bạn được an toàn và chỉ có thể truy cập trên máy tính của bạn. Về hiệu suất, Chat with RTX hoạt động tốt hơn và nhanh hơn so với các chatbot AI khác chạy Mistral 7B. Mặc dù phần lớn hiệu suất tăng cường đến từ việc sử dụng các GPU cao cấp hơn, nhưng việc sử dụng Nvidia TensorRT-LLM và RTX acceleration đã làm cho việc chạy Mistral 7B trên Chat with RTX nhanh hơn so với các cách khác để chạy một LLM tối ưu hóa cho chat.

Đáng chú ý là phiên bản Chat with RTX hiện tại chỉ là bản demo. Các phiên bản sau của Chat with RTX có khả năng sẽ được tối ưu hóa hơn và mang lại hiệu suất tốt hơn.

Giải Pháp Thay Thế Nếu Bạn Không Có GPU RTX 30 hoặc 40 Series

Nếu bạn không có GPU RTX 30 hoặc 40 Series nhưng vẫn muốn chạy LLM cục bộ, bạn có thể thử các cách khác để chạy LLM cục bộ. Hai trong số những cách phổ biến nhất là GPT4ALL và Text Gen WebUI. Hãy thử GPT4ALL nếu bạn muốn trải nghiệm chạy LLM cục bộ một cách dễ dàng. Nhưng nếu bạn có một chút kỹ thuật, việc chạy LLM qua Text Gen WebUI sẽ cung cấp khả năng điều chỉnh và linh hoạt tốt hơn.

1. Chat with RTX có thể hoạt động mà không cần kết nối Internet không?

Có, Chat with RTX có thể hoạt động hoàn toàn offline vì nó chạy trực tiếp trên máy tính của bạn.

2. Tôi cần loại GPU nào để chạy Chat with RTX?

Bạn cần GPU RTX 30-Series hoặc 40-Series để chạy Chat with RTX.

3. Chat with RTX có thể đọc và phân tích các tệp dữ liệu của tôi không?

Có, Chat with RTX hỗ trợ retrieval-augmented generation (RAG), cho phép nó đọc và phân tích các tệp dữ liệu của bạn để cung cấp câu trả lời tùy chỉnh.

4. Tôi có thể sử dụng Chat with RTX để phân tích video trên YouTube không?

Có, bạn có thể sử dụng Chat with RTX để phân tích video trên YouTube bằng cách nhập URL video vào phần Dataset.

5. Chat with RTX có an toàn để sử dụng với dữ liệu nhạy cảm không?

Có, vì Chat with RTX chạy cục bộ và không gửi dữ liệu của bạn lên máy chủ của bên thứ ba, nó rất an toàn để sử dụng với dữ liệu nhạy cảm.

6. Chat with RTX có thể được sử dụng để tạo mã lập trình không?

Có, bạn có thể sử dụng Chat with RTX để tạo mã lập trình dựa trên dữ liệu và yêu cầu của bạn.

7. Phiên bản hiện tại của Chat with RTX có phải là phiên bản cuối cùng không?

Không, phiên bản hiện tại của Chat with RTX chỉ là bản demo. Các phiên bản sau sẽ được tối ưu hóa hơn và có thể cung cấp hiệu suất tốt hơn.

Kết Luận

Chat with RTX của Nvidia là một công cụ mạnh mẽ cho những ai muốn trải nghiệm AI trên máy tính cá nhân của mình. Với khả năng RAG và hiệu suất tối ưu, nó mang lại giá trị đáng kể cho người dùng. Hãy thử tải và cài đặt Chat with RTX để khám phá những lợi ích mà nó mang lại.

Để tìm hiểu thêm về các công nghệ mới nhất trong lĩnh vực Tech, hãy truy cập Tạp Chí Mobile hoặc khám phá thêm tại chuyên mục Tech.